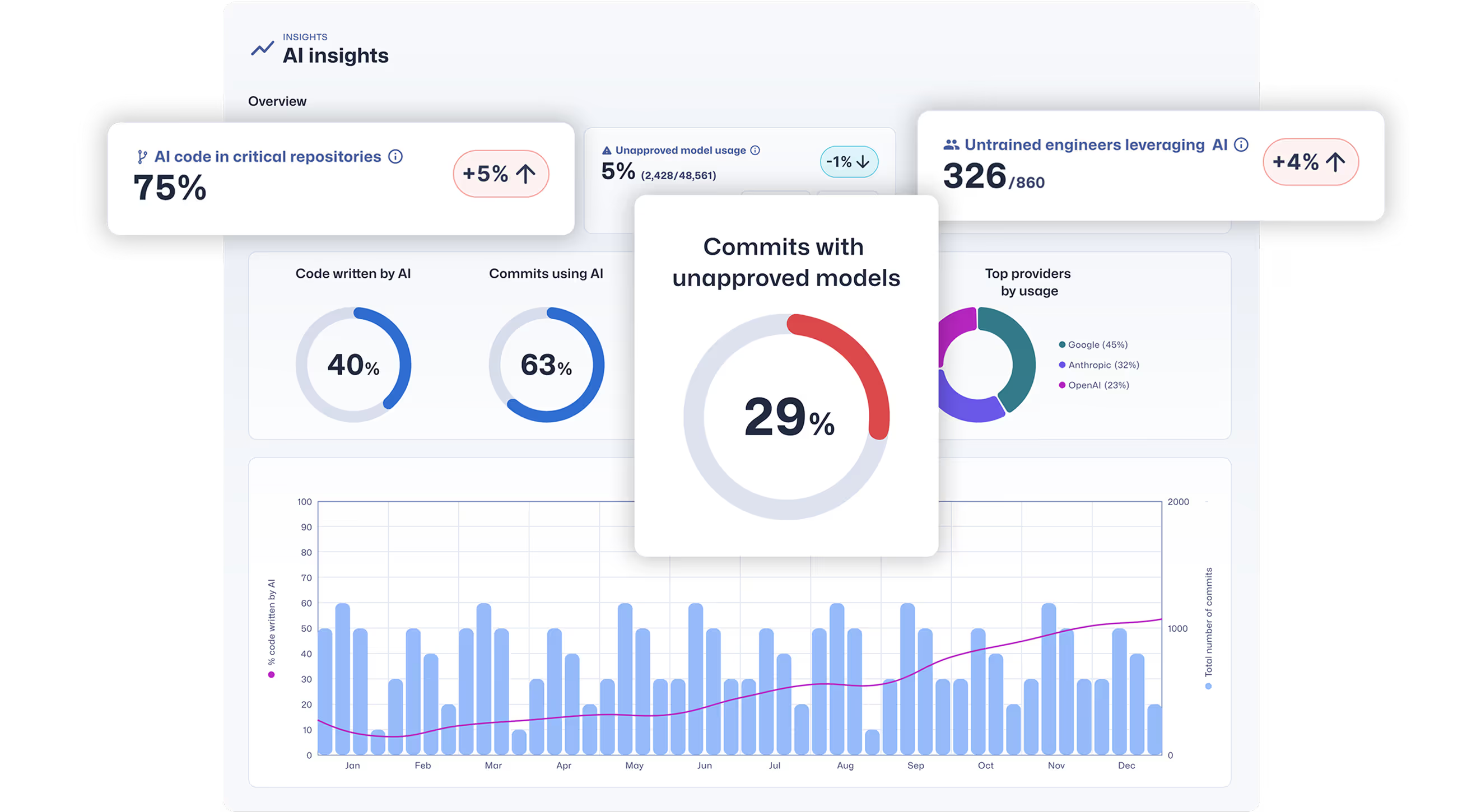

Trust Agent: AI captures AI usage signals and commit metadata — not source code or prompts — preserving developer privacy while enabling governance at scale.

Il rend le développement assisté par l'IA visible, vérifiable et gérable tout au long du cycle de vie sécurisé du développement logiciel (SDLC), aidant ainsi les organisations à identifier et à réduire les risques liés aux développeurs avant que le code n'atteigne la phase de production.