Agent fiduciaire du SCW : AI

Agent fiduciaire du SCW : AI

Visibilité et contrôle complets sur le code généré par l'IA. Innovez rapidement et en toute sécurité.

Développer des solutions sécurisées dans le nouveau monde de l'intelligence artificielle

Secure Code Warrior soutient les entreprises qui effectuent la transition vers des pratiques de développement assisté par l'IA avec des initiatives de perfectionnement très pertinentes conçues pour combler les lacunes allant du manque de sensibilisation au travail avec l'IA et les LLM, à la confiance excessive dans la sécurité du code généré par l'IA et à l'émergence de nouvelles vulnérabilités associées au codage de l'IA.

Bénéficiez d'un contenu de pointe couvrant les sujets liés à l'IA et aux LLM pour divers rôles tout au long du cycle de développement logiciel (SDLC) afin de minimiser les risques. Des développeurs et AQ aux architectes et chefs de produit, nous avons tout ce qu'il vous faut.

Développement de logiciels sécurisés de nouvelle génération

Atténuer les risques dans un monde d'IA et de développeurs

Avec plus de lignes de code produites plus rapidement et avec moins d'attention, le risque de bogues cachés, de vulnérabilités de sécurité et de dette technique augmente de façon exponentielle. Cette évolution rend la révision du code, les tests et les pratiques de codage sécurisées plus critiques que jamais, en veillant à ce que la rapidité ne se fasse pas au détriment de la fiabilité et de la sécurité. Le perfectionnement des développeurs est la première étape pour obtenir de meilleurs résultats dans un environnement où des outils tels que Github Copilot, Cursor AI, Amazon Q developer et d'autres sont utilisés et soulignent la nécessité de continuer à mettre l'accent sur la formation au codage sécurisé.

Explorer le contenu de la Learning Platform

Gérer les risques liés à l'IA grâce à l'observabilité et à la gouvernance

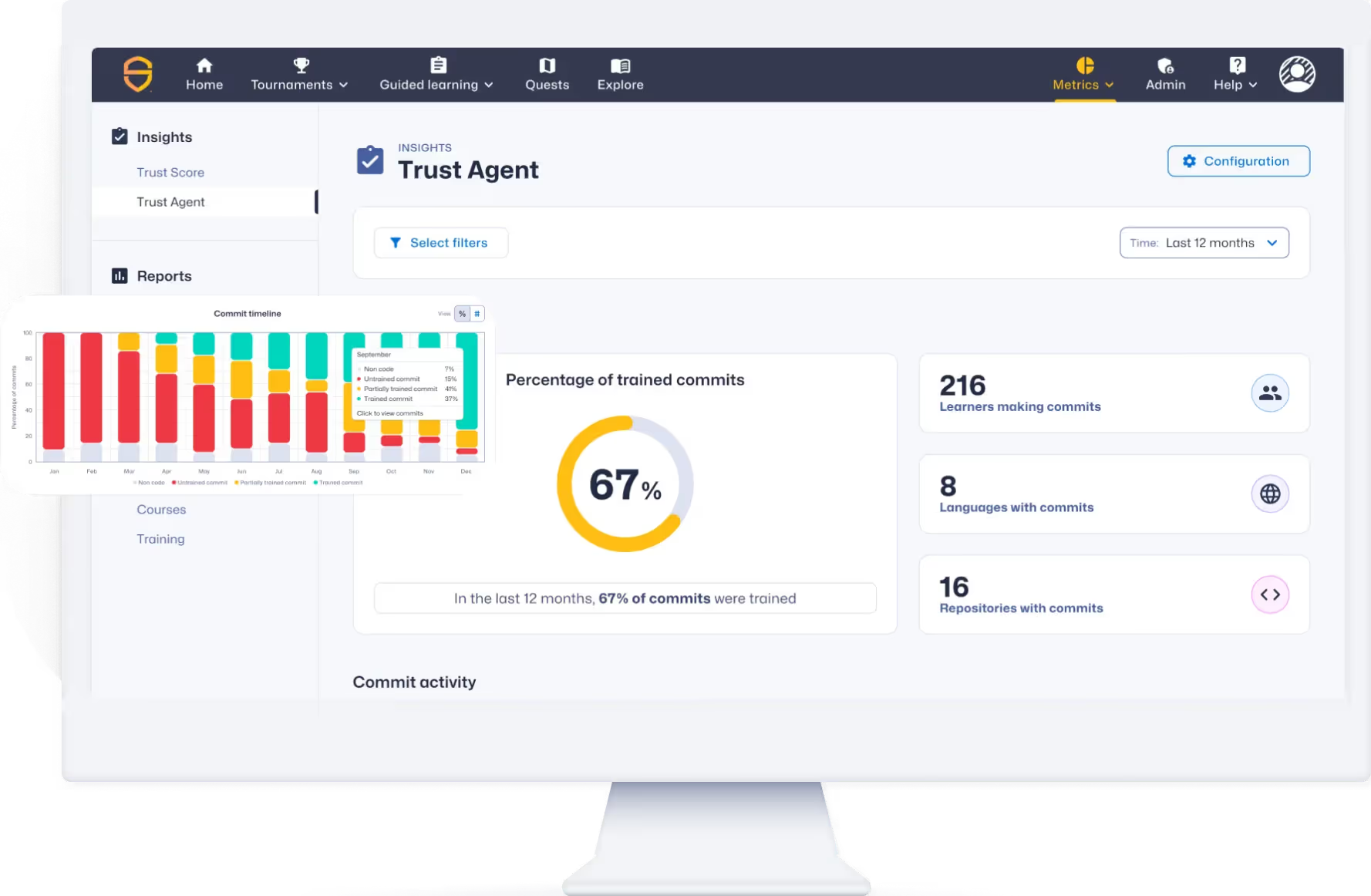

Les initiatives en matière de compétences ne sont que la première étape pour vous assurer que vous traitez les risques supplémentaires introduits par le codage assisté par l'IA. SCW Trust Agent™ vous donne une visibilité sur les développeurs qui travaillent avec votre base de code, et un aperçu de leurs compétences en matière de sécurité. Vous pouvez ensuite configurer des politiques pour les référentiels de code afin d'aider à améliorer votre posture de sécurité par le biais d'une gouvernance proactive.

Découvrez l'agent fiduciaire SCWUn impact mesurable au-delà de la conformité

Les organisations qui adoptent une approche proactive des meilleures pratiques en matière de code sécurisé, qui vont au-delà de la conformité, obtiennent des résultats commerciaux tangibles. Car le moyen le plus rentable de remédier aux vulnérabilités est de les prévenir dès le départ. SCW Trust Score™ fournit aux organisations un moyen de mesurer et d'étalonner les progrès des compétences des développeurs en matière de sécurité au fil du temps, qui sont particulièrement importants à suivre en référence à l'adoption précoce d'environnements de codage pilotés par l'IA.

Explorer la note de confiance du SCW

Guide pour une génération de code IA plus sûre avec des règles de sécurité gratuites

Les outils de codage IA sont rapides, mais pas toujours sécurisés. Secure Code Warrior Les règles de sécurité IA gratuites de offrent des garde-fous simples et légers pour aider des outils comme Copilot et Cursor à générer du code plus sûr par défaut. Faciles à adopter, à étendre et à intégrer à votre configuration, aucun compte SCW requis.

Explorez les règles de sécurité de l'IAAméliorer la productivité, mais augmenter les risques

L'adoption généralisée des outils de codage de l'IA pose un nouveau défi : le manque de visibilité et de gouvernance du code généré par l'IA.

78%

- StackOverflow

30%

- arXiv

50%

- BaxBench

Les avantages de l'agent de confiance : AI

Les nouvelles capacités d'IA de SCW Trust Agent offrent l'observabilité et le contrôle approfondis dont vous avez besoin pour gérer en toute confiance l'adoption de l'IA dans votre cycle de développement logiciel sécurisé (SDLC) sans sacrifier la sécurité.

Le défi de l'IA dans votre SDLC

Sans moyen de gérer l'utilisation de l'IA, les RSSI, les responsables AppSec et les ingénieurs sont exposés à de nouveaux risques et à des questions auxquelles ils ne peuvent pas répondre. Parmi les préoccupations, citons : le manque de visibilité sur les développeurs qui utilisent des modèles non approuvés, l'incertitude quant aux compétences en matière de sécurité des développeurs qui utilisent l'IA, l'absence d'informations sur le pourcentage de code généré par l'IA, l'incapacité à faire respecter les règles de l'IA. L'incapacité à appliquer une politique et une gouvernance pour gérer les risques liés aux outils d'IA.

- Manque de visibilité sur les développeurs qui utilisent des modèles non approuvés.

- Incertitude quant aux compétences en matière de sécurité des développeurs qui utilisent l'IA.

- Aucune indication sur le pourcentage du code de contribution généré par l'IA

- Incapacité à mettre en œuvre une politique et une gouvernance pour gérer les risques liés aux outils d'IA.

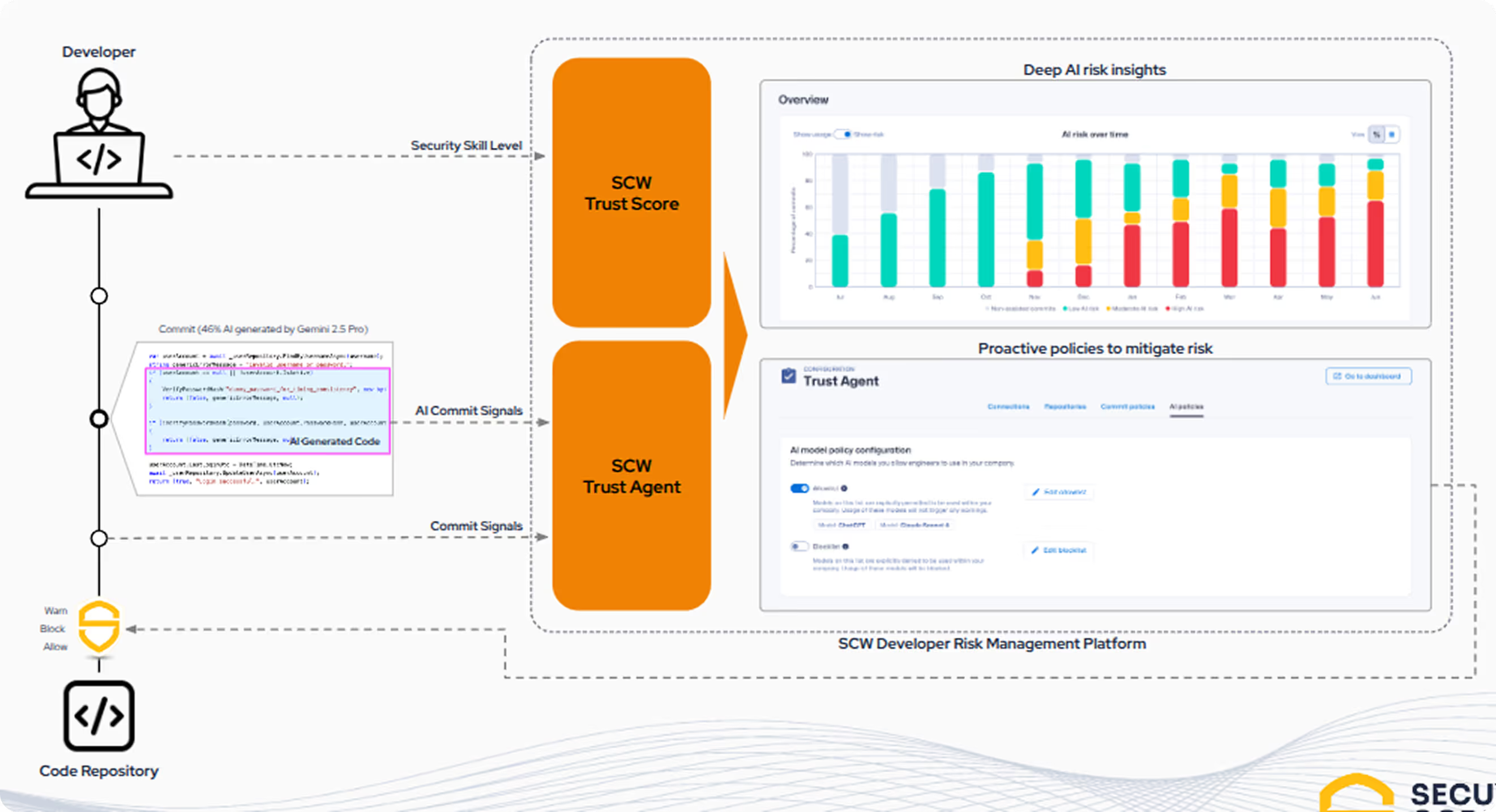

Une combinaison unique de signaux

SCW permet aux organisations d'adopter la rapidité du développement basé sur l'IA sans sacrifier la sécurité. AI Signals est la première solution à fournir une visibilité et une gouvernance en corrélant une combinaison unique de trois signaux clés pour comprendre le risque des développeurs assistés par l'IA au niveau de l'engagement.

- Utilisation des outils de codage de l'IA : Aperçu de l'utilisation des outils d'IA, des modèles LLM et des bases de code.

- Saisi en temps réel : Agent de confiance : AI intercepte le code généré par l'IA sur l'ordinateur et l'IDE du développeur.

- Compétences des développeurs en matière de codage sécurisé : Nous fournissons une compréhension claire de la compétence de codage sécurisé d'un développeur, qui est la compétence fondamentale requise pour utiliser l'IA de manière responsable.

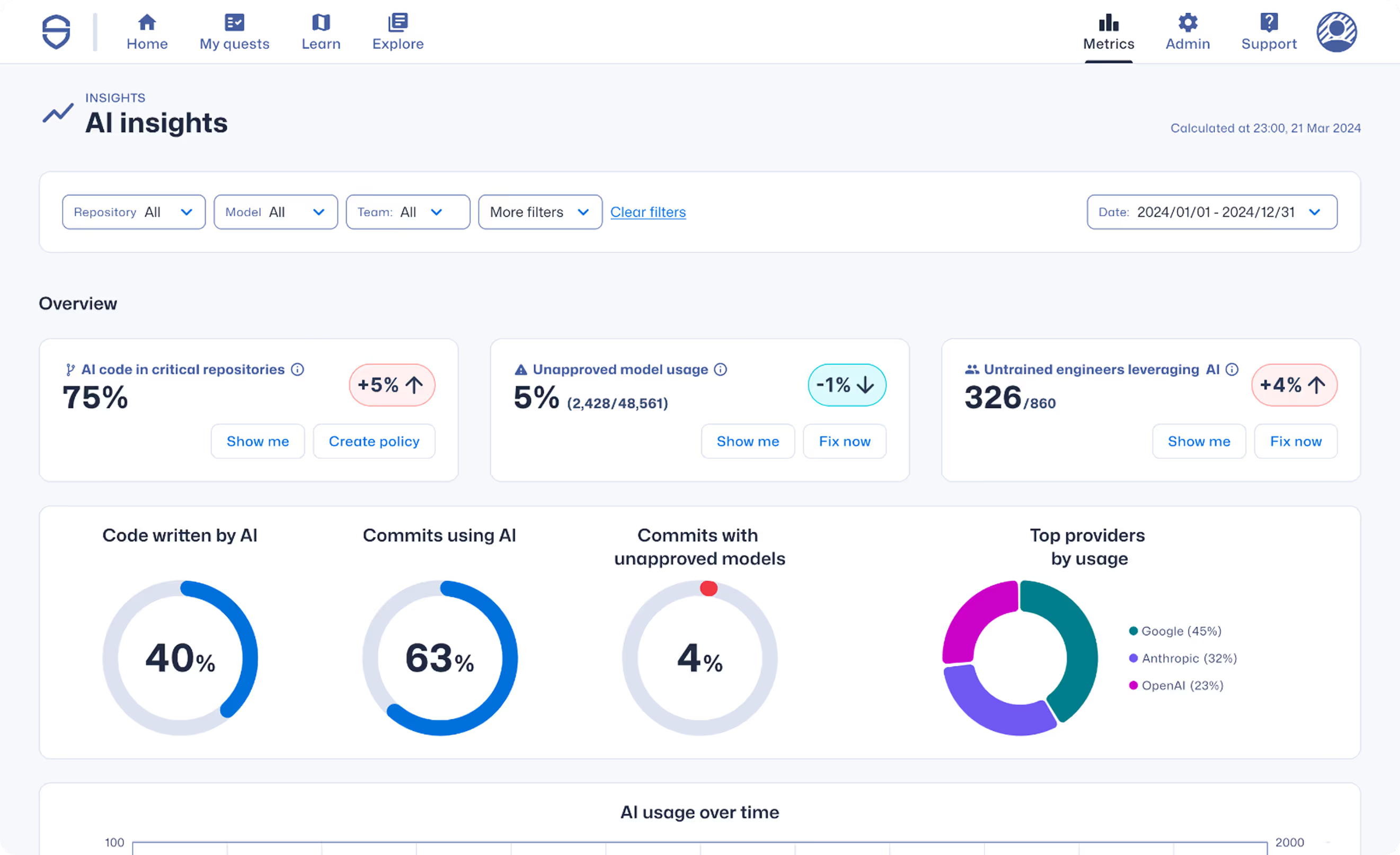

Visibilité de l'utilisation de l'IA

Obtenez une vue d'ensemble des assistants et agents de codage de l'IA, ainsi que des LLM qui les alimentent. Découvrez les outils et les modèles non approuvés. Fini l'"IA de l'ombre".

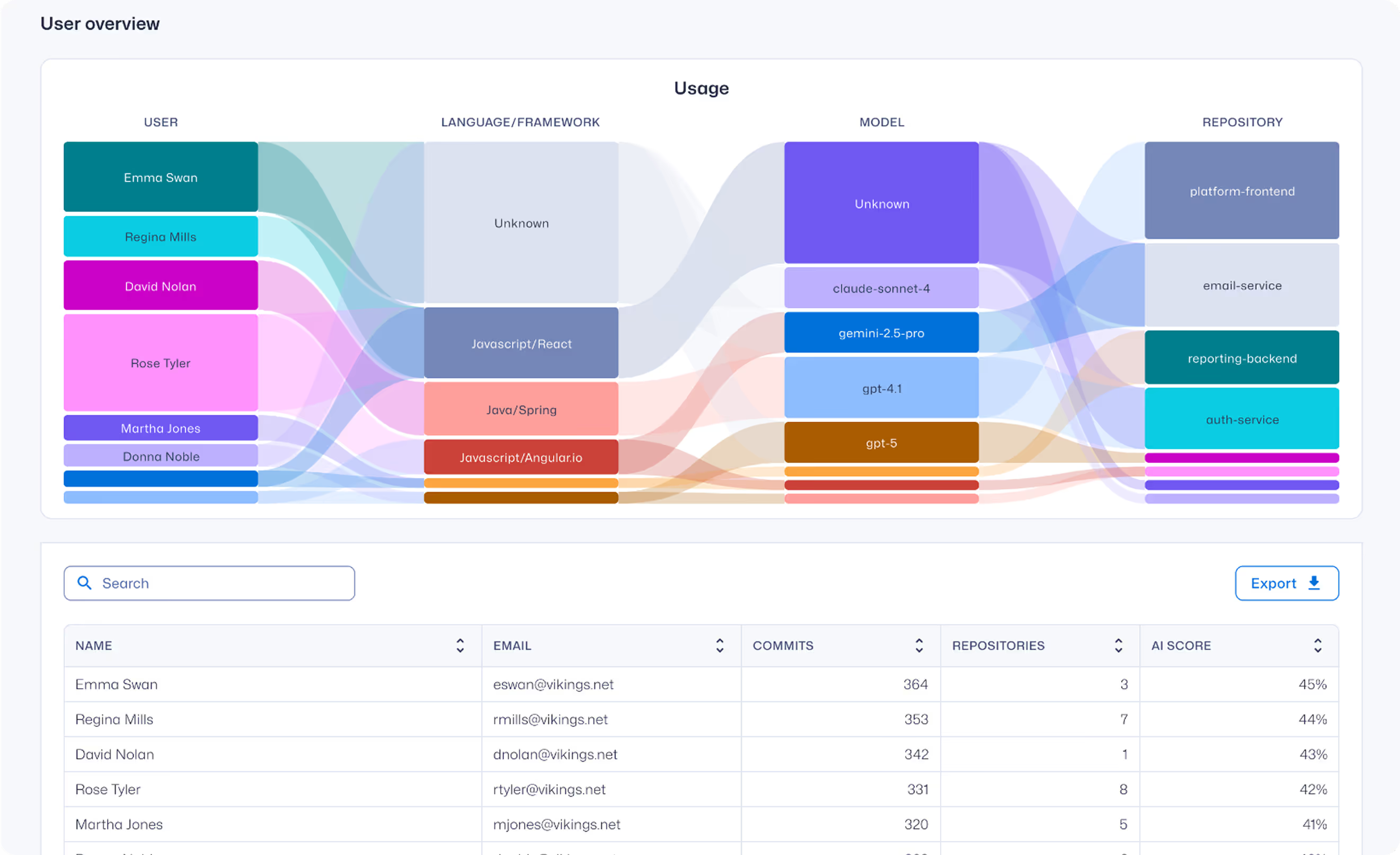

Observabilité des livraisons assistées par l'IA par développeur et par base de code

Bénéficiez d'une visibilité approfondie sur le développement de logiciels assistés par l'IA, notamment sur les développeurs qui utilisent tel ou tel modèle LLM et sur telle ou telle base de code.

Gouvernance et contrôle intégrés

Connectez le code généré par l'IA aux commits réels pour comprendre le véritable risque de sécurité introduit. Automatisez l'application des politiques pour garantir que les développeurs dotés d'IA respectent les normes de codage sécurisées avant que leurs contributions ne soient acceptées.

Découvrez AI Insights

Agent de confiance : AI donne aux entreprises une visibilité sur les risques introduits par les développeurs qui utilisent des outils de génération de code soutenus par le LLM. La solution procède en trois étapes :

- Inspecter le trafic de codes générés par l'IA : Agent de confiance : AI est déployé sous la forme d'un simple plugin IDE ou d'un agent de point final qui intercepte et surveille le code généré par les outils de codage AI, tels que GitHub Copilot, ChatGPT, Google Gemini ou Cursor.

- Enrichir avec le niveau de compétence du développeur : La dernière étape consiste à enrichir ces données avec le niveau de compétence du développeur en matière de codage sécurisé, tel que mesuré par le produit Secure Code Learning de SCW, leader sur le marché.

En corrélant ces signaux clés, Trust Agent : AI fournit des informations exploitables aux équipes de sécurité et d'ingénierie, notamment en ce qui concerne l'utilisation de modèles LLM non approuvés et l'identification des développeurs ayant des connaissances limitées en matière de codage sécurisé et qui produisent du code généré par l'IA.

Foire aux questions (FAQ)

Pourquoi devrais-je me préoccuper des risques liés au code généré par l'IA/LLM dans le cadre de mon cycle de développement durable ?

Alors que les développeurs exploitent de plus en plus les outils de codage de l'IA, une nouvelle couche de risque critique est introduite dans les cycles de développement durable. Des enquêtes montrent que 78 % des développeurs utilisent désormais ces outils, mais des études révèlent que jusqu'à 50 % du code généré par l'IA contient des failles de sécurité.

Ce manque de gouvernance et la déconnexion entre les connaissances des développeurs et la qualité du code peuvent rapidement échapper à tout contrôle, car chaque composant non sécurisé généré par l'IA ajoute à la surface d'attaque de votre organisation, compliquant ainsi les efforts de gestion des risques et de maintien de la conformité.

Pour en savoir plus, consultez ce livre blanc : Les assistants de codage de l'IA : Un guide de navigation sécurisée pour la prochaine génération de développeurs

Quels modèles et outils Trust Agent : AI détecte-t-il ?

Agent de confiance : L'IA collecte des signaux provenant d'assistants d'IA et d'outils de codage agentique tels que GitHub Copilot, Cline, Roo Code, etc. et les LLM qui les alimentent.

Actuellement, nous détectons tous les modèles fournis par OpenAI, Amazon Bedrock, Google Vertex AI et Github Copilot.

Comment Trust Agent : AI ?

Nous vous fournirons un fichier .vsix pour une installation manuelle dans Visual Studio Code, et un déploiement automatisé via des scripts de gestion des appareils mobiles (MDM) pour Intune, Jamf et Kanji sera bientôt disponible.

Les fondamentaux redéfinis.

Autres ressources Secure Code Warrior

sur AI Insights

L'injection rapide et les risques de sécurité des outils de codage agentiques

Comment un agent de codage a été piégé pour écrire du code sujet à des injections SQL, installer des outils shell et peut-être même traquer son utilisateur.

OWASP Top 10 pour les applications LLM : Ce qui est nouveau, ce qui a changé et comment rester en sécurité

Gardez une longueur d'avance dans la sécurisation des applications LLM avec les dernières mises à jour du Top 10 de l'OWASP. Découvrez ce qui est nouveau, ce qui a changé et comment Secure Code Warrior vous fournit des ressources d'apprentissage actualisées pour atténuer les risques dans l'IA générative.

Pourquoi les développeurs ont besoin de compétences en matière de sécurité pour utiliser efficacement les outils de développement de l'IA ?

La promesse d'une intelligence artificielle capable d'écrire un code complexe en appuyant sur un bouton est intrigante, mais la réalité est que l'IA aura besoin de beaucoup d'aide de la part des développeurs humains pour créer un code réellement sûr et fiable.

LLMs : Une approche (im)parfaitement humaine du codage sécurisé ?

S'il semble inévitable que la technologie de l'IA de type LLM change la façon dont nous abordons de nombreux aspects du travail - et pas seulement le développement de logiciels -, nous devons prendre du recul et envisager les risques au-delà des gros titres. Et en tant que compagnon de codage, ses défauts sont peut-être son attribut le plus "humain".

Ressources supplémentaires du Secure Code Warrior sur l'IA et les LLM

L'injection rapide et les risques de sécurité des outils de codage agentiques

Comment un agent de codage a été piégé pour écrire du code sujet à des injections SQL, installer des outils shell et peut-être même traquer son utilisateur.

OWASP Top 10 pour les applications LLM : Ce qui est nouveau, ce qui a changé et comment rester en sécurité

Gardez une longueur d'avance dans la sécurisation des applications LLM avec les dernières mises à jour du Top 10 de l'OWASP. Découvrez ce qui est nouveau, ce qui a changé et comment Secure Code Warrior vous fournit des ressources d'apprentissage actualisées pour atténuer les risques dans l'IA générative.

Pourquoi les développeurs ont besoin de compétences en matière de sécurité pour utiliser efficacement les outils de développement de l'IA ?

La promesse d'une intelligence artificielle capable d'écrire un code complexe en appuyant sur un bouton est intrigante, mais la réalité est que l'IA aura besoin de beaucoup d'aide de la part des développeurs humains pour créer un code réellement sûr et fiable.

LLMs : Une approche (im)parfaitement humaine du codage sécurisé ?

S'il semble inévitable que la technologie de l'IA de type LLM change la façon dont nous abordons de nombreux aspects du travail - et pas seulement le développement de logiciels -, nous devons prendre du recul et envisager les risques au-delà des gros titres. Et en tant que compagnon de codage, ses défauts sont peut-être son attribut le plus "humain".

Ressources pour vous aider à démarrer

Comment Envestnet a adopté un code sécurisé agile Plateforme D'apprentissage et triplé l'efficacité des développeurs dans la réduction des vulnérabilités.

Découvrez comment Derek Fisher, responsable de la sécurité des produits chez Envestnet et auteur de "The Application Security Handbook", a travaillé avec Secure Code Warrior pour développer une approche holistique visant à réduire les vulnérabilités grâce à l'activation du code sécurisé agile pour ses équipes de développeurs.

La Chambre de commerce établit la norme en matière de sécurité à grande échelle axée sur les développeurs

La Chambre de commerce néerlandaise explique comment elle a intégré le codage sécurisé dans le développement quotidien grâce à des certifications basées sur les rôles, à l'évaluation comparative du Trust Score et à une culture de responsabilité partagée en matière de sécurité.

DigitalOcean réduit sa dette de sécurité avec Secure Code Warrior

L'utilisation par DigitalOcean de la formation Secure Code Warrior a considérablement réduit la dette de sécurité, permettant aux équipes de se concentrer davantage sur l'innovation et la productivité. L'amélioration de la sécurité a renforcé la qualité des produits et l'avantage concurrentiel de l'entreprise. À l'avenir, le score de confiance SCW les aidera à améliorer leurs pratiques de sécurité et à continuer à stimuler l'innovation.