Empêcher les risques liés aux logiciels d'IA avant qu'ils ne surviennent

Quel que soit l'auteur (ou l'origine), chaque soumission doit être accompagnée d'un code sécurisé et de haute qualité.

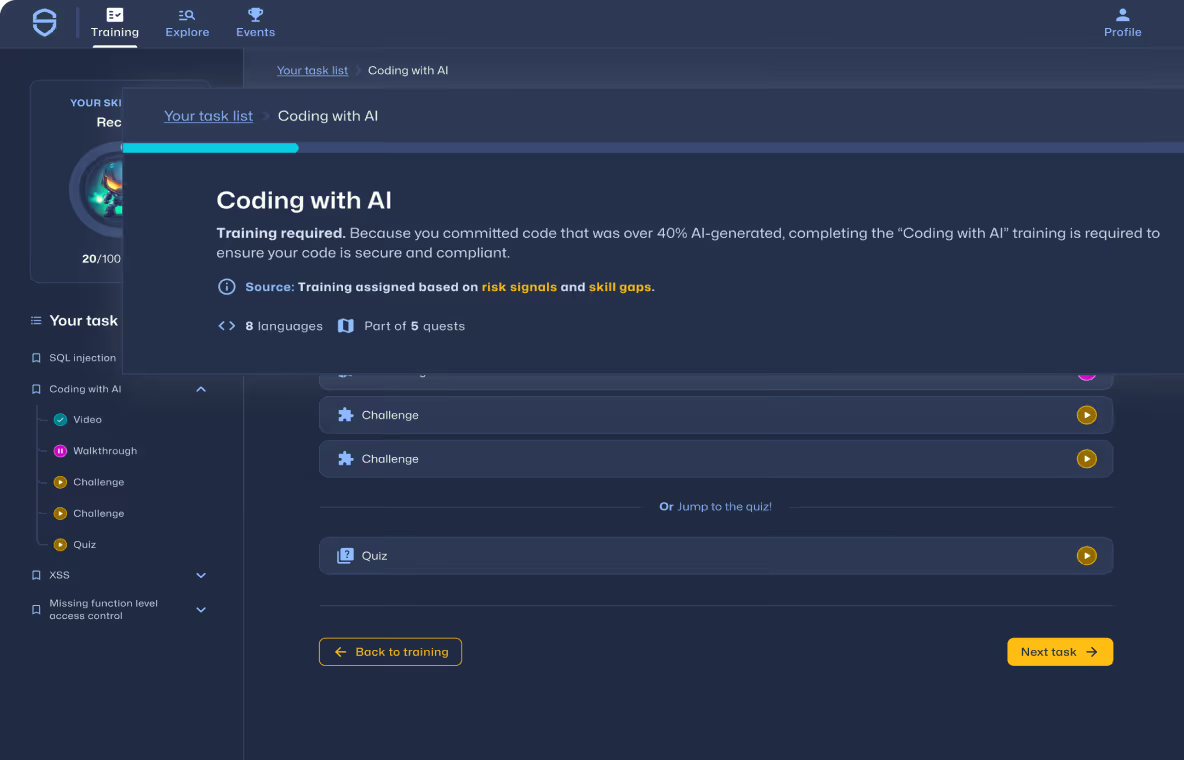

Contrôle de la surface de développement alimenté par l'intelligence artificielle

Rendre le développement alimenté par l'intelligence artificielle visible, sécurisé et résilient, prévenir les vulnérabilités avant la mise en production, afin que les équipes puissent agir rapidement et en toute confiance.

Gouvernance d'entreprise à grande échelle, développement de l'IA en toute confiance.

Élaborez des politiques, obtenez une visibilité à l'échelle de l'entreprise et prévenez les risques incontrôlés liés à l'IA tout au long du cycle de vie du développement.

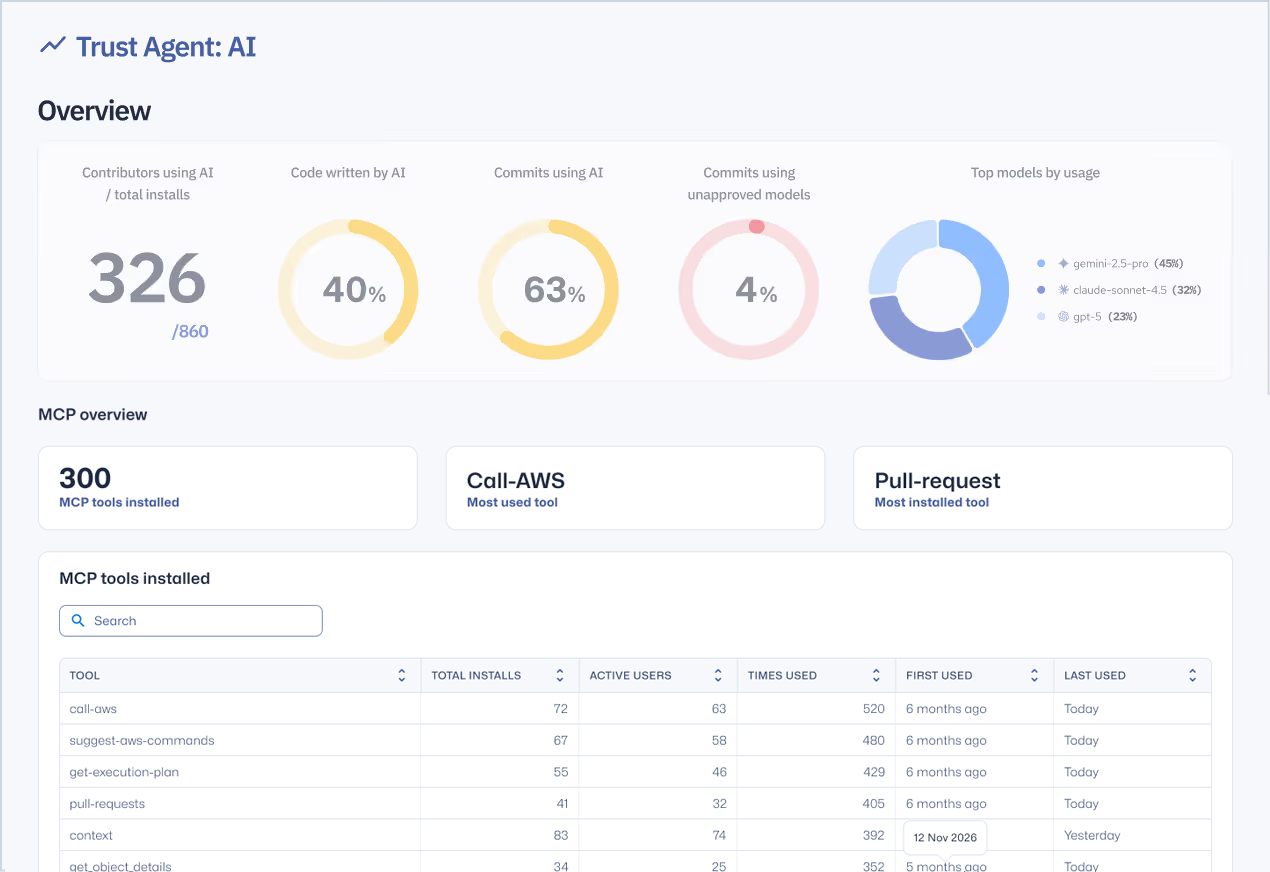

Comprendre la quantité de code générée par l'IA

- Définir et mettre en œuvre une stratégie de développement sécurisé dans le cadre du processus de travail de l'IA

- Renforcer les capacités de codage sécurisé au sein des équipes d'ingénieurs

- Participation à une formation pratique sur les langages et les vulnérabilités

Prévention des vulnérabilités introduites par l'IA lors de la soumission

Réduction de plus de 53 % des vulnérabilités introduites

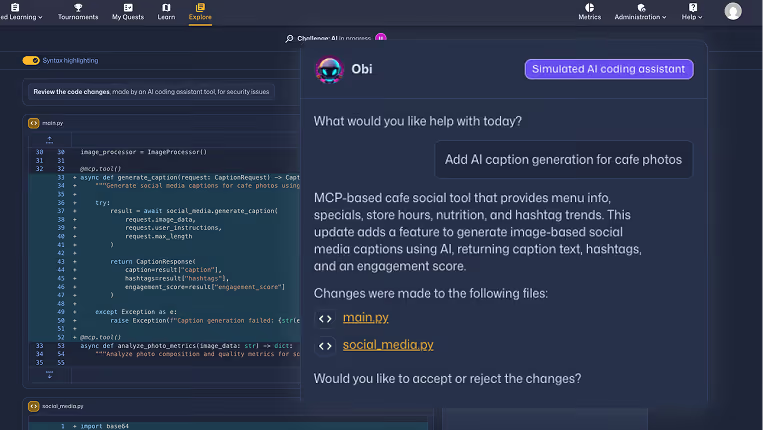

- Développer des compétences en codage sécurisé dans les flux de travail axés sur les développeurs et l'intelligence artificielle

- Fournir des conseils conformes aux politiques directement dans les outils de développement

- Découvrez l'impact du code généré par l'IA sur les risques logiciels.

Accélérer le développement de l'IA sans ralentir la cadence

Réduction maximale de 82 % du MTTR

- Amélioration mesurable des compétences grâce à l'apprentissage adaptatif et aux expériences pratiques

- Fournissez des conseils en temps réel dans les outils de développement.

- Corrigez les vulnérabilités plus tôt afin de réduire les coûts liés aux retouches.

Conçu pour être sécurisé et compatible avec les outils que vous utilisez déjà

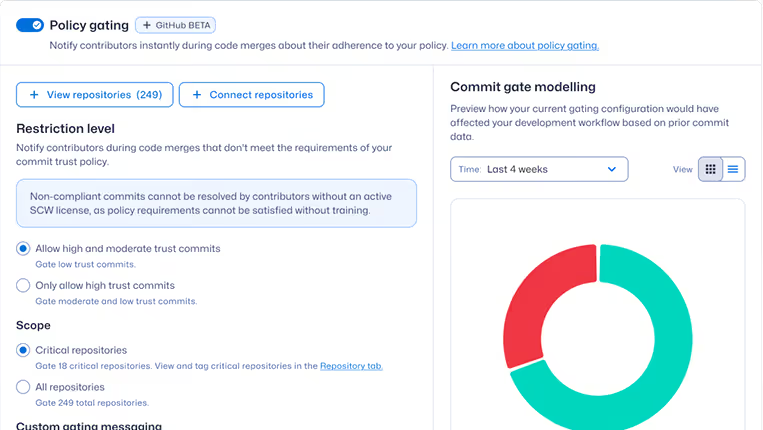

Rendre les risques liés au développement basé sur l'intelligence artificielle plus visibles

Veuillez examiner comment le code IA est utilisé, les risques qu'il présente et les comportements qui le sous-tendent, afin de pouvoir le bloquer avant que la vulnérabilité ne soit publiée.

Réduire les vulnérabilités à la source

Formation sur la sécurité du codage et l'intelligence artificielle intégrée au flux de travail des développeurs dans le monde réel, permettant aux organisations de réduire les vulnérabilités de plus de 53 %.

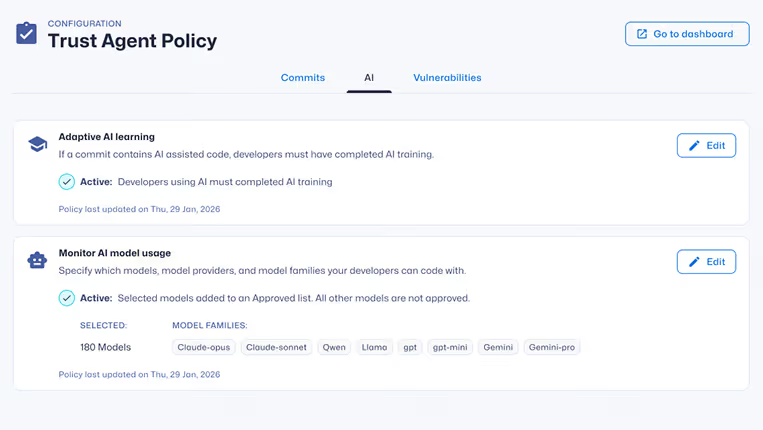

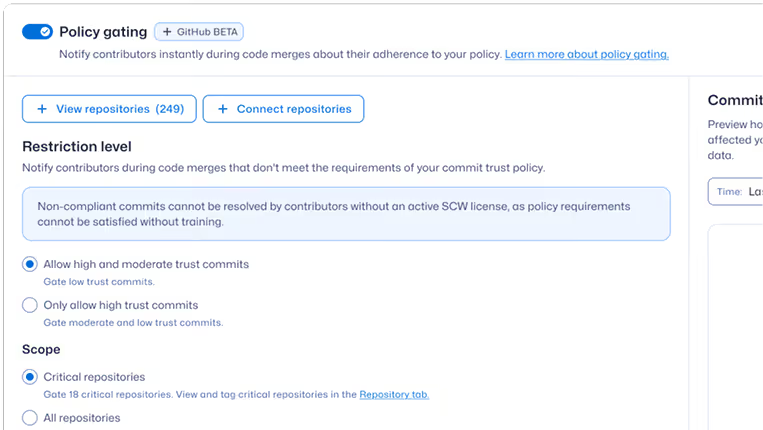

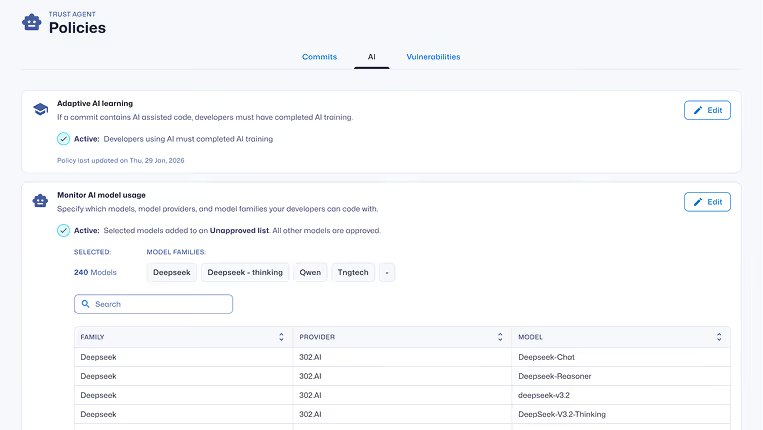

Mise en œuvre à grande échelle des contrôles des politiques relatives aux développeurs et à l'IA

Mettre en œuvre et contrôler le cycle de vie du développement logiciel basé sur l'intelligence artificielle, tout en prévenant les risques, en appliquant les politiques et en démontrant la confiance avant la mise en production du code.

Vérifier la sécurité des développements basés sur l'intelligence artificielle avant leur publication

Évaluer les risques liés aux développeurs, mettre en œuvre des politiques et prévenir les vulnérabilités tout au long du cycle de vie du développement logiciel.

Ressources pour vous aider à démarrer

La Chambre de commerce néerlandaise explique comment elle a intégré le codage sécurisé dans le développement quotidien grâce à des certifications basées sur les rôles, à l'évaluation comparative du Trust Score et à une culture de responsabilité partagée en matière de sécurité.

Découvrez les changements apportés au Top 10 OWASP : 2025 et Secure Code Warrior facilite la transition grâce à des missions, des cours et des informations pour les développeurs mis à jour.

Le monde de la cybersécurité va-t-il trop vite en matière d'IA agentique ? L'avenir de la sécurité de l'IA est là, et il est temps pour les experts de passer de la réflexion à la réalité.

Comprendre la gouvernance des logiciels d'IA et comment réduire les risques liés aux logiciels basés sur l'intelligence artificielle

Comprenez ce qu'est la gouvernance des logiciels d'intelligence artificielle, son importance, et Secure Code Warrior aider les organisations à adopter en toute sécurité le développement assisté par l'intelligence artificielle.

.svg)

%20(1).avif)

.avif)