L'IA élargit votre chaîne logistique logicielle.

Les assistants de codage IA, les agents connectés à LLM et MCP peuvent désormais générer du code de production dans votre référentiel. Le rythme de développement s'est accéléré, mais la gouvernance n'a pas suivi. L'intelligence artificielle est devenue un contributeur incontrôlé dans votre chaîne logistique logicielle.

La plupart des organisations ne sont pas en mesure de répondre clairement à la question suivante :

- Quels modèles d'IA ont généré des soumissions spécifiques ?

- Ces modèles produisent-ils des résultats fiables de manière constante ?

- Quels serveurs MCP sont actifs et à quoi ont-ils accès ?

- La soumission assistée par l'intelligence artificielle est-elle conforme aux normes de codage sécurisé ?

- Comment l'utilisation de l'intelligence artificielle affecte-t-elle le risque logiciel global ?

Sans une gouvernance structurée des logiciels d'intelligence artificielle, les organisations risquent de se retrouver confrontées à une fragmentation de la propriété, à une visibilité limitée et à une exposition croissante. Le développement assisté par l'intelligence artificielle accélère la vitesse de codage , mais sans supervision obligatoire, il augmente également les risques liés aux vulnérabilités introduites et à la chaîne d'approvisionnement des modèles.

Supervision obligatoire du développement axé sur l'intelligence artificielle

Cela permet aux organisations de :

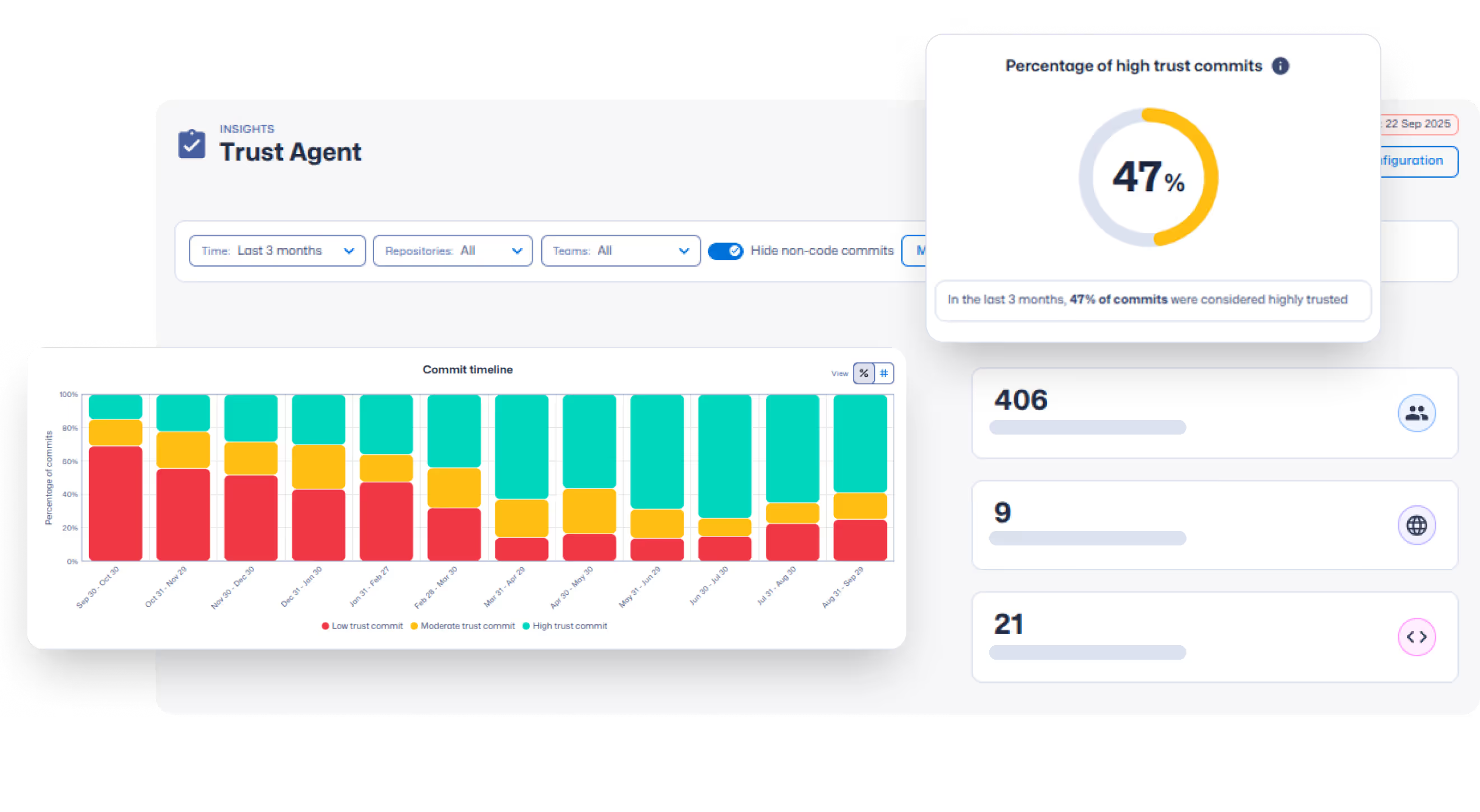

- Comprendre en profondeur où et comment l'intelligence artificielle est utilisée

- Associer la soumission assistée par IA aux risques logiciels

- Définir et mettre en œuvre la politique d'utilisation de l'IA lors de la soumission

- Renforcer la responsabilité en matière de développement assisté par l'intelligence artificielle et humaine

Gestion du cycle de vie des logiciels d'intelligence artificielle

Les outils traditionnels de sécurité des applications détectent les vulnérabilités après l'écriture du code. La gouvernance logicielle par l'intelligence artificielle applique les politiques, vérifie l'utilisation des modèles d'IA et corrèle les risques, empêchant ainsi les vulnérabilités d'entrer en production.

Traçabilité des outils et modèles d'IA

Identifier les outils et modèles d'IA qui affectent le code dans le référentiel afin de créer un inventaire vérifiable de l'utilisation de l'IA.

Détection d'ombre par IA

Identifier les outils et modèles d'IA non autorisés fonctionnant en dehors des contrôles de gouvernance approuvés.

LLM Test de référence de sécurité

Évaluer les performances des modèles d'IA en fonction des modèles de vulnérabilité réels et exiger l'utilisation de modèles approuvés.

Évaluation des risques et gouvernance au niveau du comité

Relier la soumission assistée par IA aux signaux de risque et appliquer des politiques exécutables avant la mise en production du code.

Visibilité du serveur MCP

Identifier les serveurs MCP en cours d'utilisation et appliquer des politiques de niveau soumission aux connexions non autorisées.

Développement et intelligence

Identifier de manière continue les développeurs, les activités assistées par l'intelligence artificielle et les modèles de soumission afin de renforcer la responsabilité et la visibilité des risques.

Gérer le développement assisté par l'IA en quatre étapes

Connecter et observer

Intégration avec le référentiel et le système d'intégration continue afin de surveiller les métadonnées de soumission, l'utilisation des modèles d'IA et l'activité des contributeurs.

Les personnes que nous servons

Lorem Issum diam quis eim leboutis ein selerisque lobortis sepitis beelrisque lobortis sepitis celerisque lobortis celeriskue filmentis celeriskue filmentis celeriskue diam

Gérer le développement et la publication des applications avant leur lancement par l'intelligence artificielle

Suivre l'utilisation des modèles d'IA. Appliquer les politiques lors de la soumission. Maintenir le contrôle de la chaîne logistique des logiciels d'IA en vue d'un audit.

Développement de logiciels d'aide à l'IA pour le contrôle, la mesure et la protection

Découvrez Secure Code Warrior apporte l'observabilité, l'application des politiques et la gouvernance de l'IA dans les workflows de développement assistés par l'IA.