AI はソフトウェアサプライチェーンを拡大しました

AI コーディングアシスタント、LLM、MCP に接続されたエージェントが、リポジトリ全体でプロダクションコードを生成できるようになりました。開発速度は加速しましたが、ガバナンスはそれに追いついていませんでした。AI はソフトウェアサプライチェーンへの統制の行き届かない一因となっています。

ほとんどの組織は、次の質問に明確に答えることができません。

- どのAIモデルが特定のコミットを生成したのか

- それらのモデルが一貫して安全な出力を生み出すかどうか

- どの MCP サーバーがアクティブで、何にアクセスしているか

- AI アシストコミットが安全なコーディング標準を満たしているかどうか

- AI の使用がソフトウェア全体のリスクに与える影響

構造化されたAIソフトウェアガバナンスがなければ、組織は所有権の分断と可視性の低下という問題に直面し、 露出の増加。 AI支援開発はコードの速度を向上させますが、強制力のある監視がなければ、導入された脆弱性リスクやモデルサプライチェーンの露出も増えます。

AI 主導型開発に対する強制力のある監視

これにより、組織は次のことが可能になります。

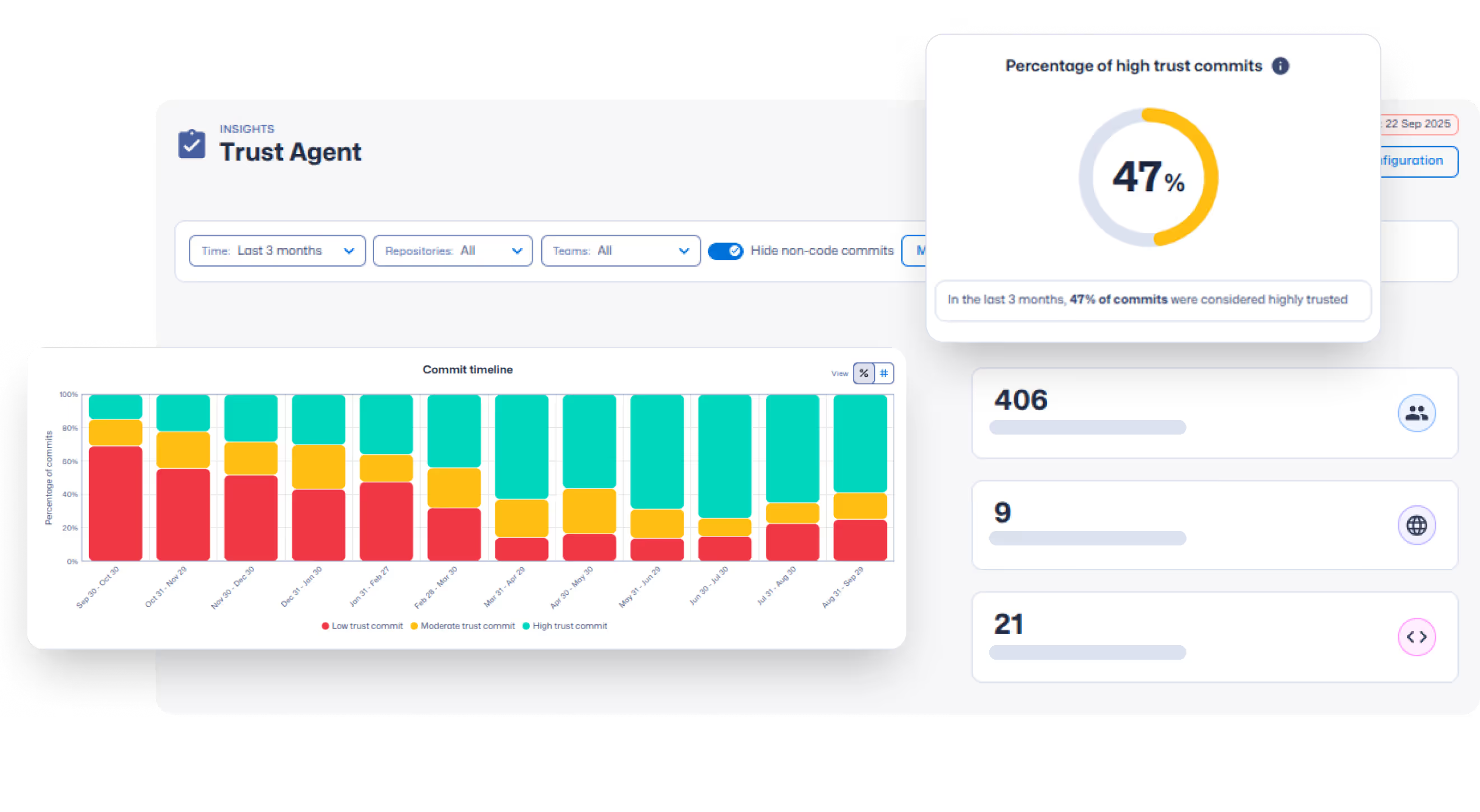

- AI がどこでどのように使用されているかを可視化

- AI アシストによるコミットとソフトウェアリスクの関連付け

- コミット時に AI 使用ポリシーを定義して適用する

- 人材開発とAI支援開発全体にわたる説明責任の強化

AI ソフトウェアライフサイクルを管理

従来のアプリケーションセキュリティツールは、コードが記述された後に脆弱性を検出します。AI ソフトウェアガバナンスは、ポリシーを適用し、AI モデルの使用状況を検証し、コミット時にリスクを相関させることで、導入された脆弱性が本番環境に導入される前に防止します。

AI ツールとモデルのトレーサビリティ

どのAIツールとモデルがリポジトリ全体のコードに影響を与えているかを可視化し、AIの使用状況の検証可能なインベントリを作成します。

シャドウ AI 検出

承認されたガバナンスコントロールの範囲外で運用されている無許可の AI ツールとモデルを特定します。

LLM セキュリティベンチマーキング

AIモデルのパフォーマンスを実際の脆弱性パターンと照らし合わせて評価し、承認されたモデルを義務付けます。

コミットレベルのリスクスコアリングとガバナンス

AIが支援するコミットをリスクシグナルと相関させ、コードが本番環境に届く前に強制力のあるポリシーを適用します。

MCP サーバーの可視性

使用中のMCPサーバーを特定し、未承認の接続にはコミットレベルのポリシーを適用します。

開発者発見とインテリジェンス

開発者、AI を活用したアクティビティ、コミットパターンを継続的に特定して、説明責任とリスクの可視性を強化します。

私たちがサービスを提供するオーディエンス

これは、オーラが射手と鼻の穴を広げることによって、腸管を熱的に発芽させ、臭いを帯びていることを防ぐためのものです。

AI 主導の開発を出荷前に管理

AI モデルの使用状況をトレースします。コミット時にポリシーを適用します。AI ソフトウェアのサプライチェーンを監査可能な状態に保ちましょう。

AI 支援ソフトウェア開発の制御、測定、保護

Secure Code Warriorが、AI支援開発ワークフロー全体でAIのオブザーバビリティ、ポリシーの適用、ガバナンスをどのように実現するかをご覧ください。