L'IA a élargi votre chaîne logistique logicielle.

Les assistants de codage IA, les LLM et les agents connectés au MCP génèrent désormais du code de production tout au long du cycle de vie du développement logiciel (SDLC). La vitesse de développement s'est accélérée, mais la gouvernance n'a pas suivi le rythme. L'IA est devenue un contributeur non contrôlé à votre chaîne logistique logicielle.

La plupart des organisations ne sont pas en mesure de répondre clairement à la question suivante :

- Quels modèles d'IA ont généré des commits spécifiques ?

- Si ces modèles produisent systématiquement un code sécurisé

- Quels sont les serveurs MCP actifs et à quoi ont-ils accès ?

- Les commits assistés par l'IA respectent-ils les normes de codage sécurisé ?

- Comment l'utilisation de l'IA influe sur le risque logiciel global

Sans une gouvernance structurée des logiciels d'IA, les organisations sont confrontées à une fragmentation des responsabilités, à une visibilité limitée et à une exposition croissante.

Le développement assisté par l'IA accélère la vitesse de codage, mais sans surveillance efficace, il augmente également le risque de vulnérabilité et l'exposition de la chaîne d'approvisionnement des modèles.

Surveillance du développement axé sur l'IA

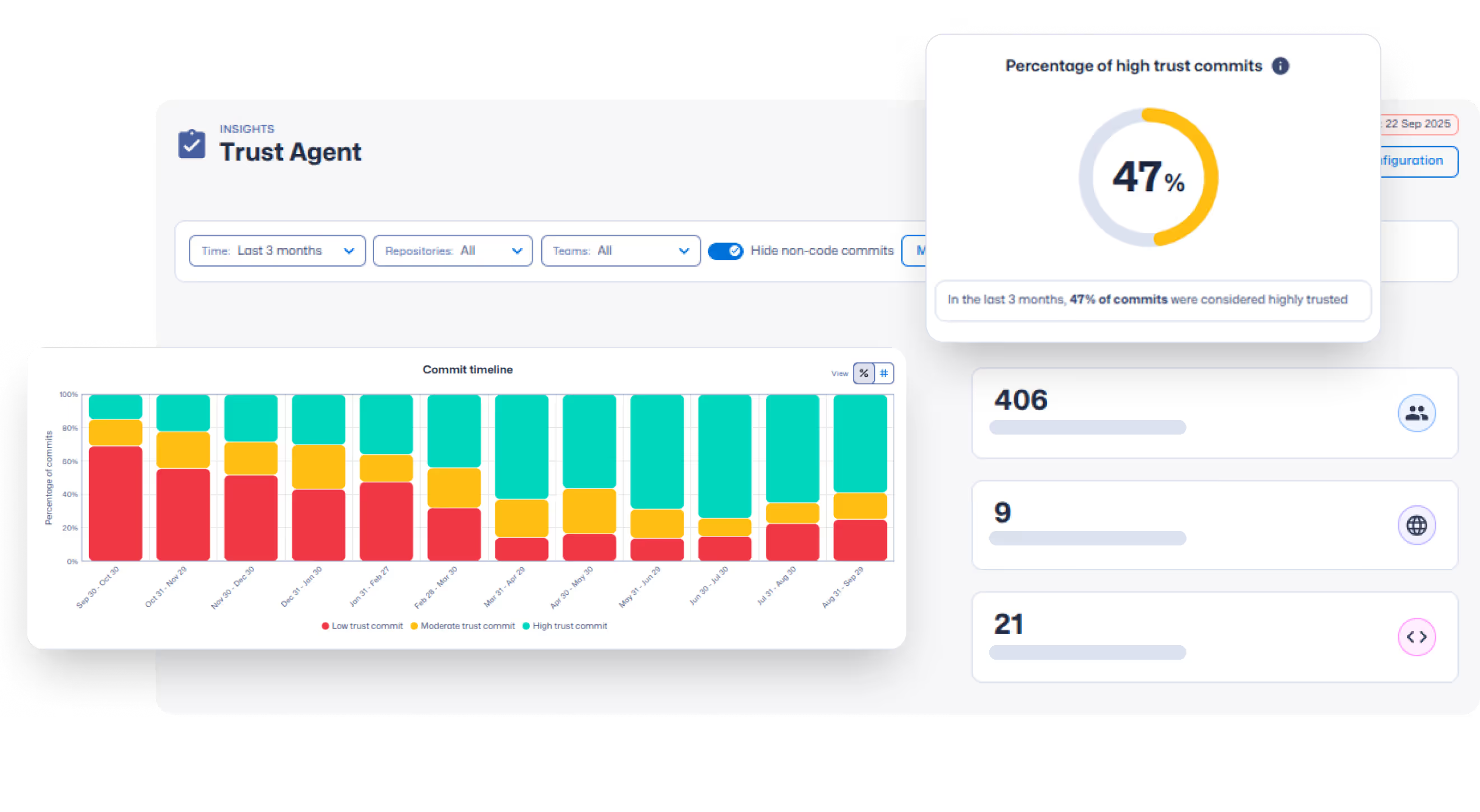

La gouvernance des logiciels d'IA rend visible le code généré par l'IA, corrèle les risques au niveau des commits et aligne le développement basé sur l'IA avec la politique de sécurité. Elle relie la visibilité de l'utilisation de l'IA, les informations sur les risques et les connaissances des développeurs tout au long du cycle de vie du développement logiciel.

Il permet aux organisations de :

- Obtenez une meilleure visibilité sur l'emplacement et la manière dont l'IA est utilisée pour générer du code.

- Corrélation des validations assistées par l'IA avec les risques logiciels

- Définir la politique d'utilisation de l'IA et les normes de gouvernance

- Assurer la responsabilité à la fois pour le code humain et le code généré par l'IA

Gérer et faire évoluer en toute sécurité le développement de logiciels basés sur l'IA

Les outils traditionnels de sécurité des applications détectent les vulnérabilités après l'écriture du code. La gouvernance logicielle de l'IA offre une visibilité sur l'utilisation des modèles d'IA, corrèle les signaux de risque lors de la validation et aide les organisations à aligner le développement sur les politiques de codage sécurisé.

Traçabilité des outils et modèles d'IA

Obtenez une meilleure visibilité sur les outils d'IA qui contribuent au code, en créant une SBOM IA vérifiable.

Détection de l'IA fantôme

Identifier les outils d'IA non autorisés fonctionnant en dehors des politiques de gouvernance approuvées.

Évaluation comparative de la sécurité LLM

Obtenez des mesures de performance IA concrètes pour orienter l'utilisation des modèles approuvés.

Évaluation des risques

Corrélation des engagements assistés par l'IA avec les signaux de risque et déclenchement d'un apprentissage ciblé afin de réduire les vulnérabilités.

Visibilité du serveur MCP

Identifiez les serveurs du protocole de contexte du modèle et comprenez comment les agents IA interagissent avec les systèmes internes.

Découverte des développeurs

Identifiez en permanence les développeurs et les modèles d'engagement afin de renforcer la responsabilité et la visibilité des risques.

Gérer le développement assisté par l'IA en quatre étapes

Connectez-vous et observez

Intégrez-le à des référentiels et à des pipelines d'intégration continue afin de surveiller les métadonnées de validation, l'utilisation des modèles d'IA et l'activité des contributeurs.

Référence et score

Évaluez les engagements assistés par l'IA par rapport aux critères de référence en matière de vulnérabilité et aux indicateurs Trust Score® des développeurs.

Spécialement conçu pour les équipes chargées de la gouvernance de l'IA

Conçu pour les responsables chargés de sécuriser le développement logiciel à l'heure où l'IA devient un élément central du code de production.

Contrôler l'

s de développement basées sur l'IA avant leur déploiement

Découvrez comment les outils d'IA génèrent du code, établissent des corrélations entre les commits et les signaux de risque, et assurent la visibilité tout au long de votre chaîne logistique logicielle d'IA.

Contrôler, mesurer et sécuriser le développement de logiciels assisté par l'IA

Découvrez comment Secure Code Warrior l'observabilité, l'application des politiques et la gouvernance de l'IA dans les workflows de développement assistés par l'IA.