L'IA a élargi votre chaîne d'approvisionnement logicielle

Les assistants de codage IA, les LLM et les agents connectés au MCP génèrent désormais du code de production via le SDLC. La vitesse de développement s'est accélérée, mais la gouvernance n'a pas suivi le rythme. L'IA est devenue un acteur non régi de votre chaîne d'approvisionnement logicielle.

La plupart des organisations ne peuvent pas répondre clairement aux questions suivantes :

- Quels modèles d'IA ont généré des commits spécifiques

- Si ces modèles produisent régulièrement du code sécurisé

- Quels serveurs MCP sont actifs et à quoi ils accèdent

- Si les commits assistés par l'IA répondent aux normes de codage sécurisées

- L'impact de l'utilisation de l'IA sur le risque logiciel global

Sans gouvernance structurée des logiciels d'IA, les entreprises sont confrontées à une propriété fragmentée, à une visibilité limitée et exposition croissante.

Le développement assisté par l'IA augmente la vitesse du code, mais sans supervision contraignante, il augmente également le risque de vulnérabilité introduit et l'exposition de la chaîne d'approvisionnement des modèles.

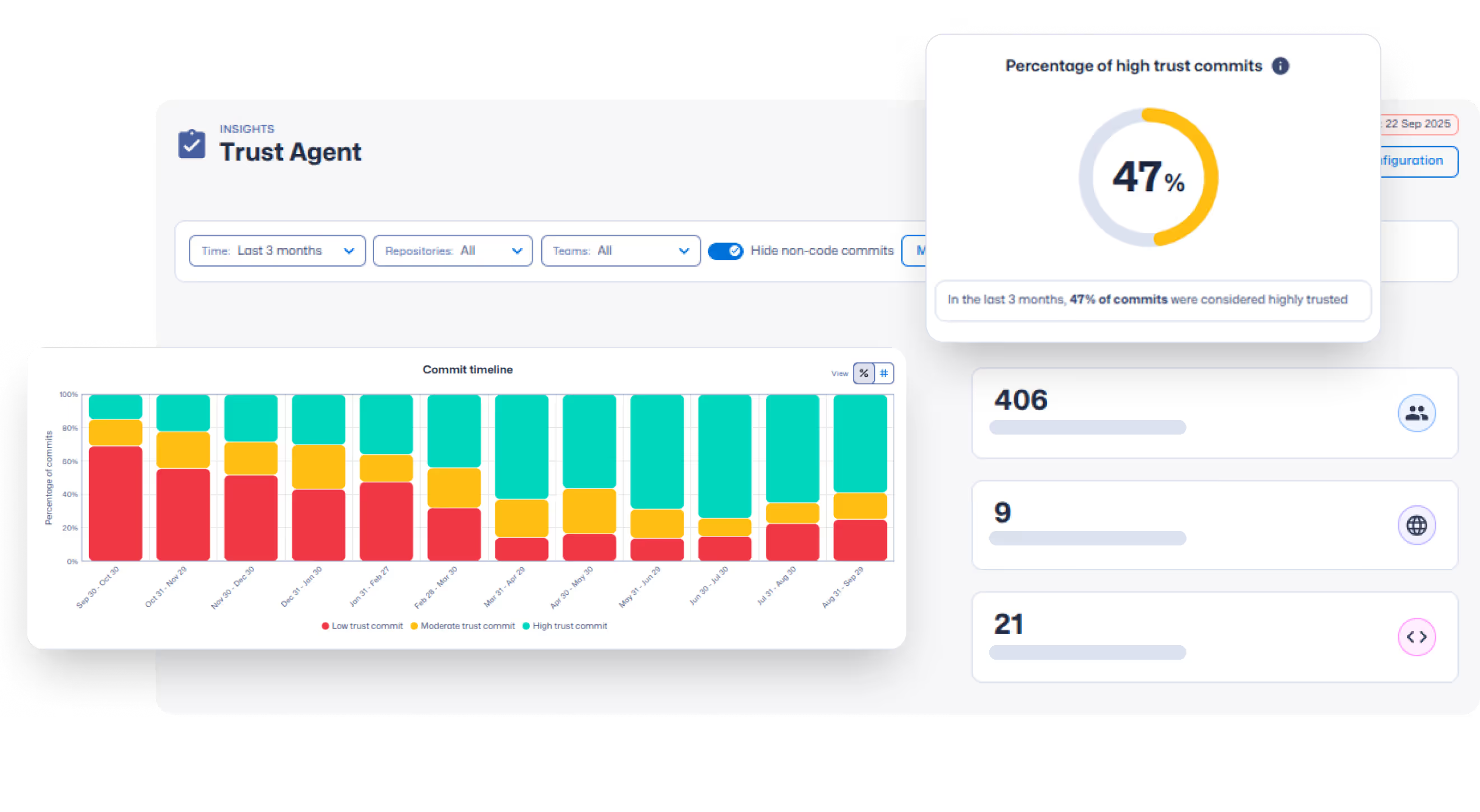

Supervision du développement piloté par l'IA

La gouvernance des logiciels d'IA rend le code généré par l'IA visible, met en corrélation le risque au niveau du commit et aligne le développement piloté par l'IA sur la politique de sécurité. Il associe la visibilité de l'utilisation de l'IA, les informations sur les risques et les informations sur les capacités des développeurs tout au long du cycle de vie du développement logiciel.

Il permet aux organisations de :

- Gagnez en visibilité sur l'endroit et la manière dont l'IA est utilisée pour générer du code

- Corréler les commits assistés par l'IA au risque logiciel

- Définir la politique d'utilisation de l'IA et les normes de gouvernance

- Assurez la responsabilité à travers le code généré par l'homme et l'IA

Gérez et adaptez en toute sécurité le développement de logiciels piloté par l'IA

Les outils traditionnels de sécurité des applications détectent les vulnérabilités une fois le code écrit. La gouvernance des logiciels d'IA fournit une visibilité sur l'utilisation des modèles d'IA, met en corrélation les signaux de risque au moment de la validation et aide les organisations à aligner le développement sur des politiques de codage sécurisées.

Traçabilité des outils et des modèles d'IA

Gagnez en visibilité sur les outils d'IA qui contribuent au code, en créant un SBOM IA vérifiable.

Détection Shadow AI

Identifiez les outils d'IA non autorisés qui fonctionnent en dehors des politiques de gouvernance approuvées.

Analyse comparative de la sécurité LLM

Obtenez des mesures de performance de l'IA réelles pour guider l'utilisation approuvée des modèles.

Notation des risques

Corrélez les commits assistés par l'IA aux signaux de risque et déclenchez un apprentissage ciblé pour réduire les vulnérabilités.

Visibilité du serveur MCP

Identifiez les serveurs du Model Context Protocol et comprenez comment les agents d'IA interagissent avec les systèmes internes.

Découverte pour les développeurs

Identifiez en permanence les développeurs et adoptez des modèles pour renforcer la responsabilité et la visibilité des risques.

Gérez le développement assisté par l'IA en quatre étapes

Connectez-vous et observez

Intégrez les référentiels et les pipelines CI pour surveiller les métadonnées de validation, l'utilisation des modèles d'IA et l'activité des contributeurs.

Point de référence et score

Évaluez les commits assistés par l'IA par rapport aux benchmarks de vulnérabilité et aux métriques Trust Score® des développeurs.

Spécialement conçu pour les équipes de gouvernance de l'IA

Conçu pour les leaders chargés de sécuriser le développement logiciel alors que l'IA devient un contributeur essentiel au code de production.

Gérez le développement piloté par l'IA

avant son expédition

Découvrez où les outils d'IA génèrent du code, corrélent les commits aux signaux de risque et maintenez la visibilité sur l'ensemble de votre chaîne d'approvisionnement en logiciels d'IA.

Contrôlez, mesurez et sécurisez le développement de logiciels assisté par l'IA

Découvrez comment Secure Code Warrior assure l'observabilité de l'IA, l'application des politiques et la gouvernance dans les flux de travail de développement assistés par l'IA.