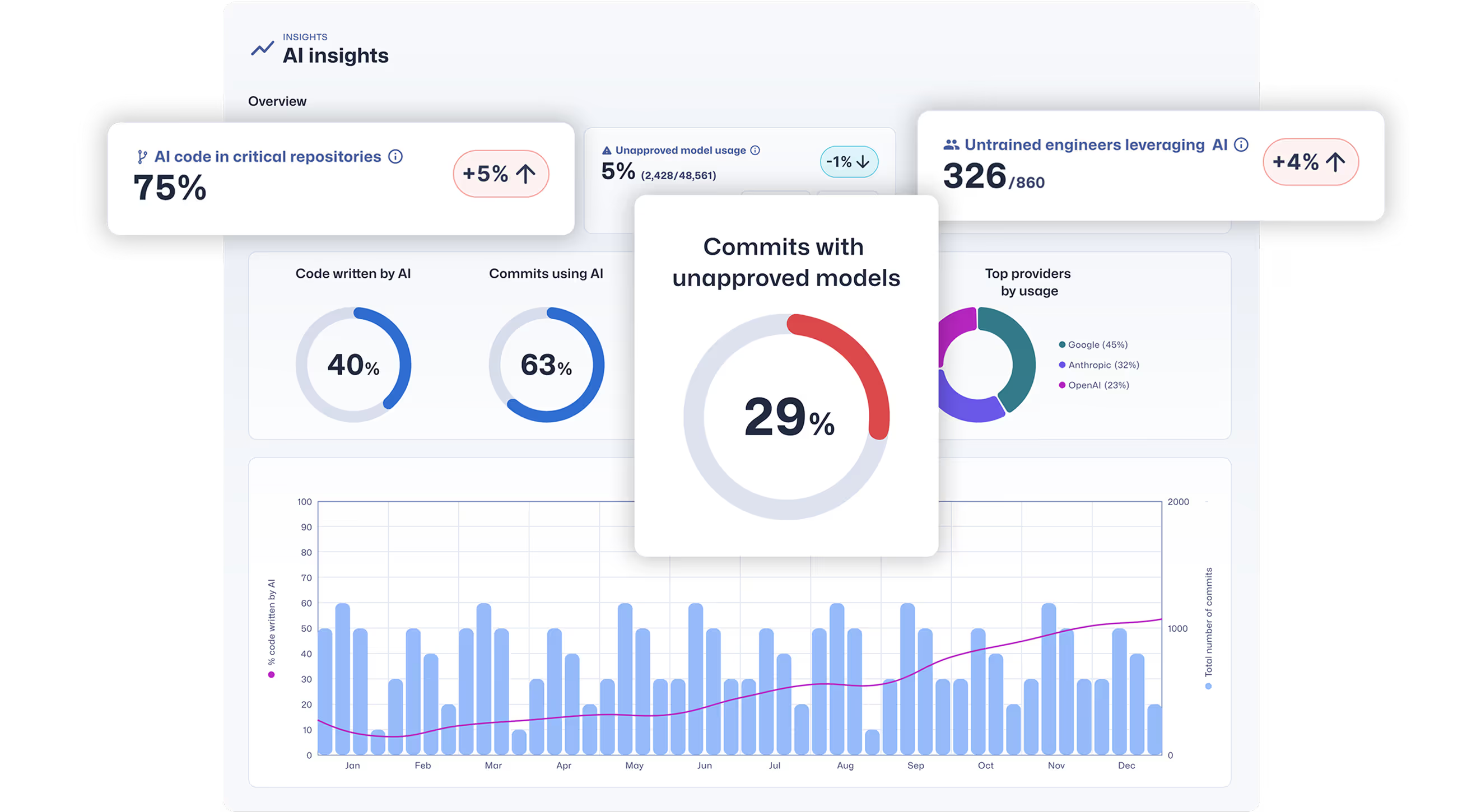

Agent de confiance : l'IA capture les signaux d'utilisation de l'IA et valide les métadonnées, et non le code source ou les instructions, tout en préservant la confidentialité des développeurs et en permettant une gouvernance à grande échelle. Il rend le développement assisté par l'IA auditable et géré à travers le SDLC sécurisé, gérant ainsi les risques pour les développeurs avant la production.

Il rend le développement assisté par l'IA visible, vérifiable et gérable tout au long du cycle de vie sécurisé du développement logiciel (SDLC), aidant ainsi les organisations à identifier et à réduire les risques liés aux développeurs avant que le code n'atteigne la phase de production.