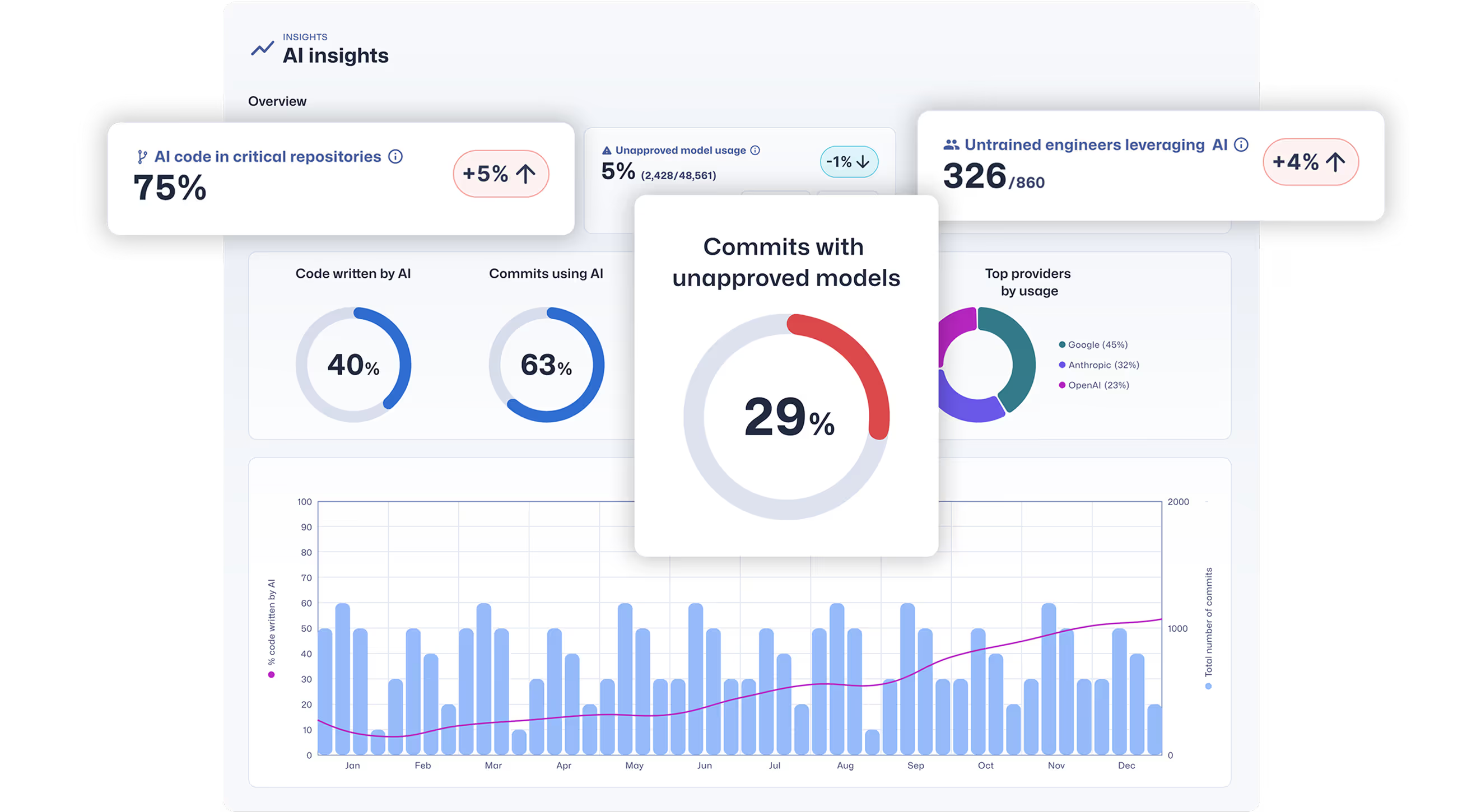

Agent de confiance : l'IA capture les signaux d'utilisation de l'IA et transmet des métadonnées (et non le code source ou les invites de commande), ce qui préserve la confidentialité des développeurs tout en permettant une gouvernance complète. Cela permet de vérifier et de contrôler le développement basé sur l'IA dans un SDLC sécurisé, de sorte que le risque lié aux développeurs est géré avant même la mise en production.

Il rend le développement assisté par l'IA visible, vérifiable et gérable tout au long du cycle de vie sécurisé du développement logiciel (SDLC), aidant ainsi les organisations à identifier et à réduire les risques liés aux développeurs avant que le code n'atteigne la phase de production.