AI는 코드를 작성할 수 있지만 기술은 그것을 보호합니다.

엔터프라이즈 보안 코딩 플랫폼은 전송 속도 저하 없이 사람과 AI 생성 코드 모두를 보호하는 데 필요한 기술을 구축합니다.

기존 보안 교육은 다음 사항에 중점을 둡니다. — 능력이 아닙니다.정적 스캐닝은 문제가 도입된 후 문제를 감지합니다. 소프트웨어 위험을 줄이려면 보안 코딩 동작 개선이 필요합니다. 보안 코딩 기능은 효과적인 AI 소프트웨어 거버넌스의 기반입니다.

Build developer capability for secure AI development

Secure Code Warrior Learning provides AI security training that builds the skills behind every commit. Developers learn to secure AI-generated code through hands-on practice across real-world AI workflows, reducing risk at the source.

대규모 보안 코딩 역량 구축

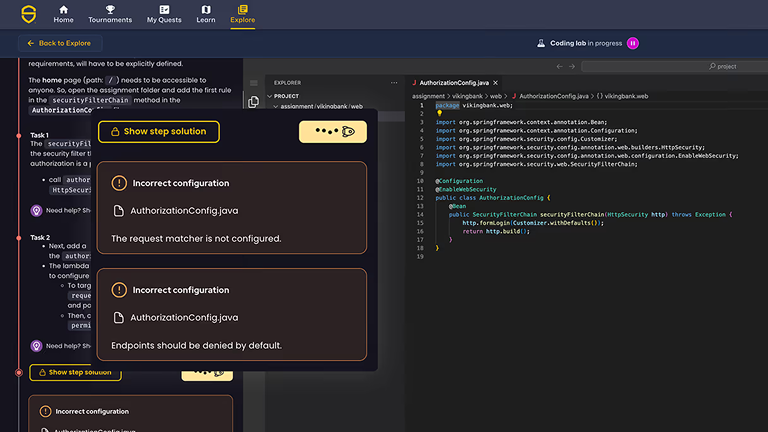

핸즈온 시큐어 코딩 랩

개발자는 75개 이상의 언어와 프레임워크에서 대화형 연습을 통해 실제 취약점을 해결합니다.

AI 전용 보안 모듈

AI 생성 코드를 검증 및 보호하고, 안전하지 않은 패턴을 감지하고, AI 지원 워크플로우에 보안 표준을 적용합니다.

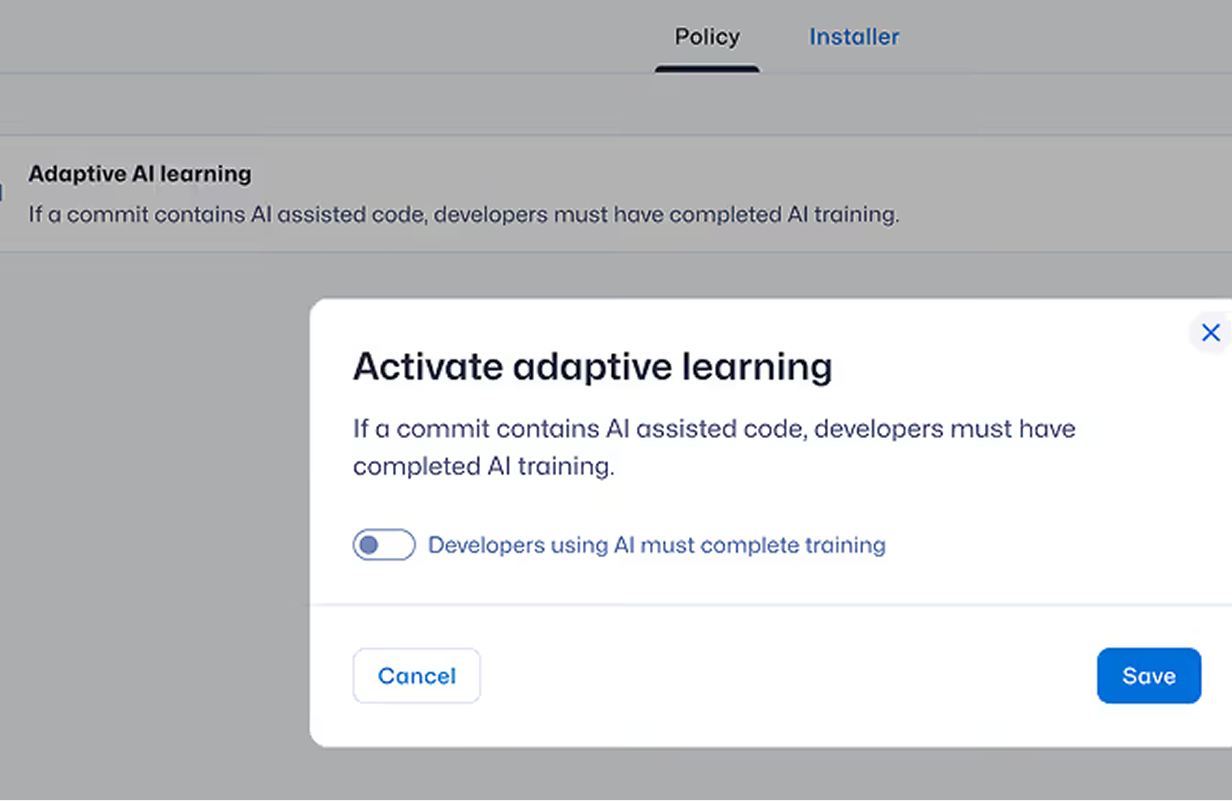

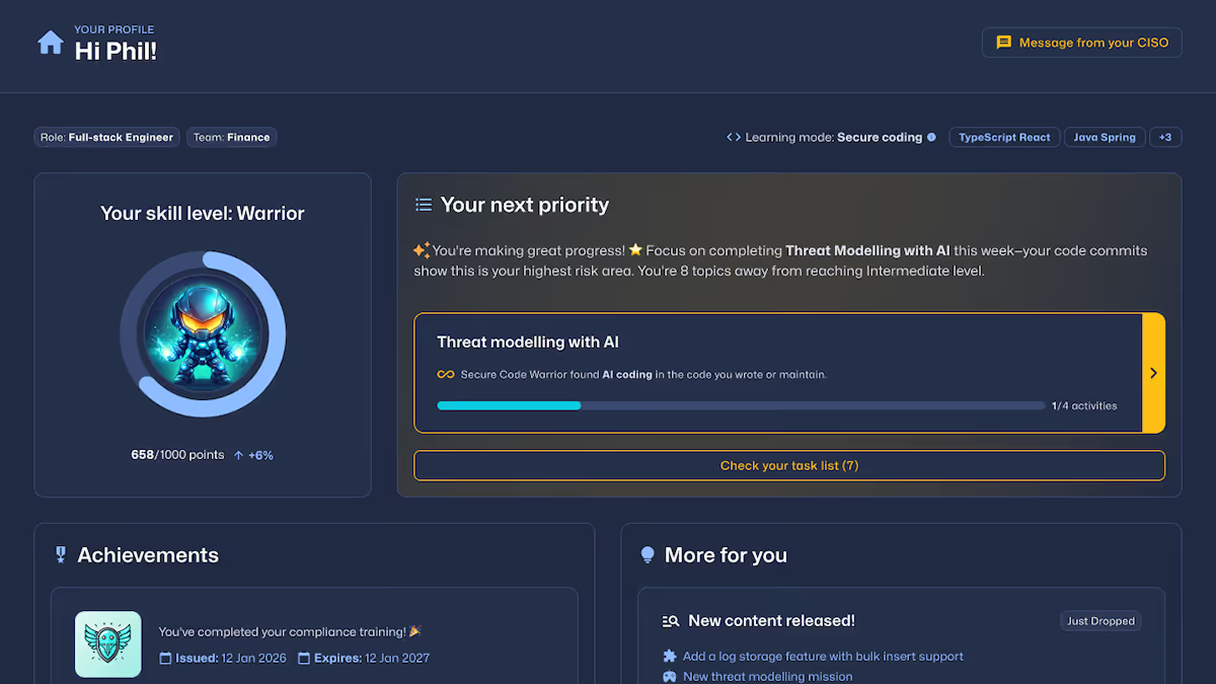

적응형 학습 경로

개발자 행동, 커밋 위험 신호 또는 벤치마크 격차를 기반으로 맞춤형 교육을 자동으로 할당합니다.

진행 상황 측정

SCW Trust Score® 를 사용하여 개발자 숙련도를 평가하고, 동종 업체와 벤치마킹하고, 측정 가능한 보안 코딩 진행 상황을 추적할 수 있습니다.

Respect des réglementations

OWASP 상위 10위, NIST, PCI DSS, CRA 및 NIS2에 맞게 교육을 조정하여 감사가 가능한 보고서를 제공합니다.

Plan de contrôle pour le développement basé sur l'IA

Rendez le développement basé sur l'IA visible, sécurisé et flexible afin de prévenir les vulnérabilités avant la production, permettant ainsi à votre équipe d'avancer rapidement et en toute confiance.

Quêtes

Laboratoires de codage

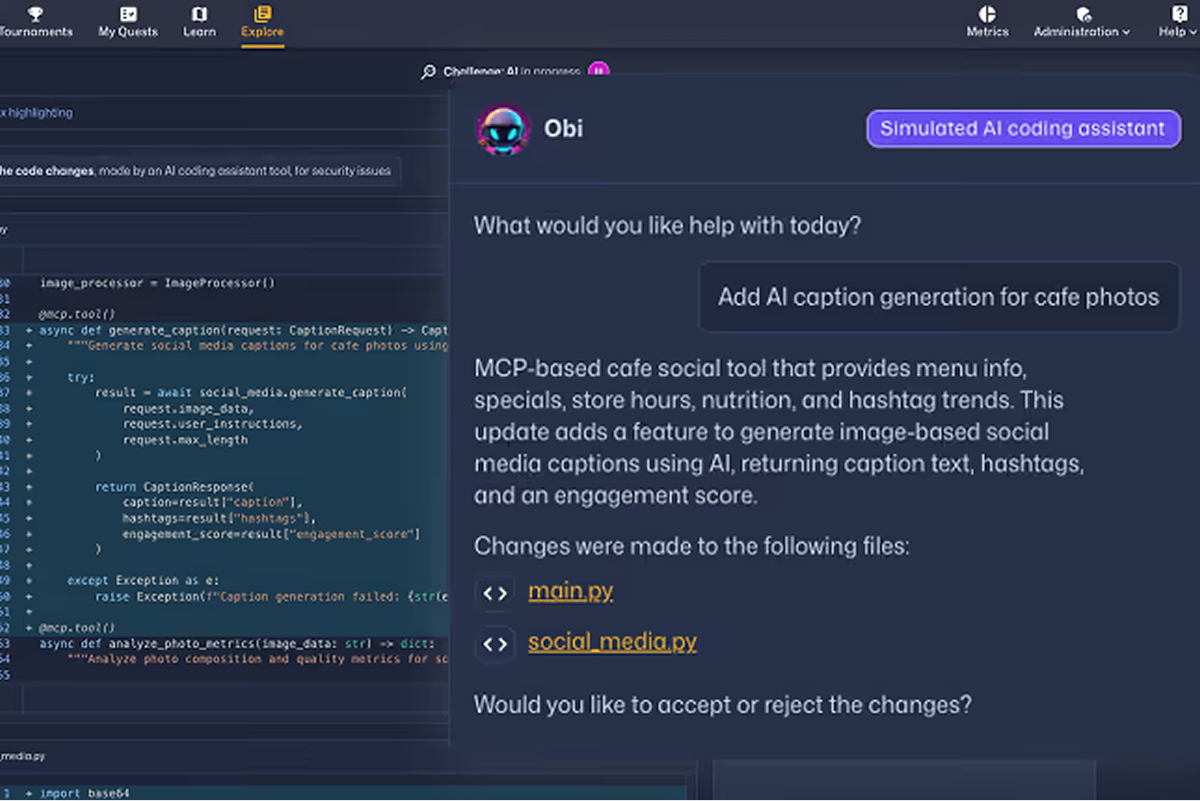

Les défis de l'IA

Check out the SCW Learning Content Guide which outlines the breadth and depth of training available across the Secure Code Warrior platform, including secure coding vulnerabilities, AI security topics, programming languages, frameworks, and role-based learning paths.

Missions

Réduction de la vulnérabilité des sources

Secure Code Warrior Learning은 반복되는 취약점을 줄이고 보안 코딩 습관을 강화하며 개발자의 측정 가능한 개선 사항을 보여줍니다.이러한 결과는 현대 개발 환경 전반에 걸쳐 엔터프라이즈 보안 코딩 교육이 대규모로 미치는 영향을 측정 가능한 수준으로 보여줍니다.

문제 해결 시간

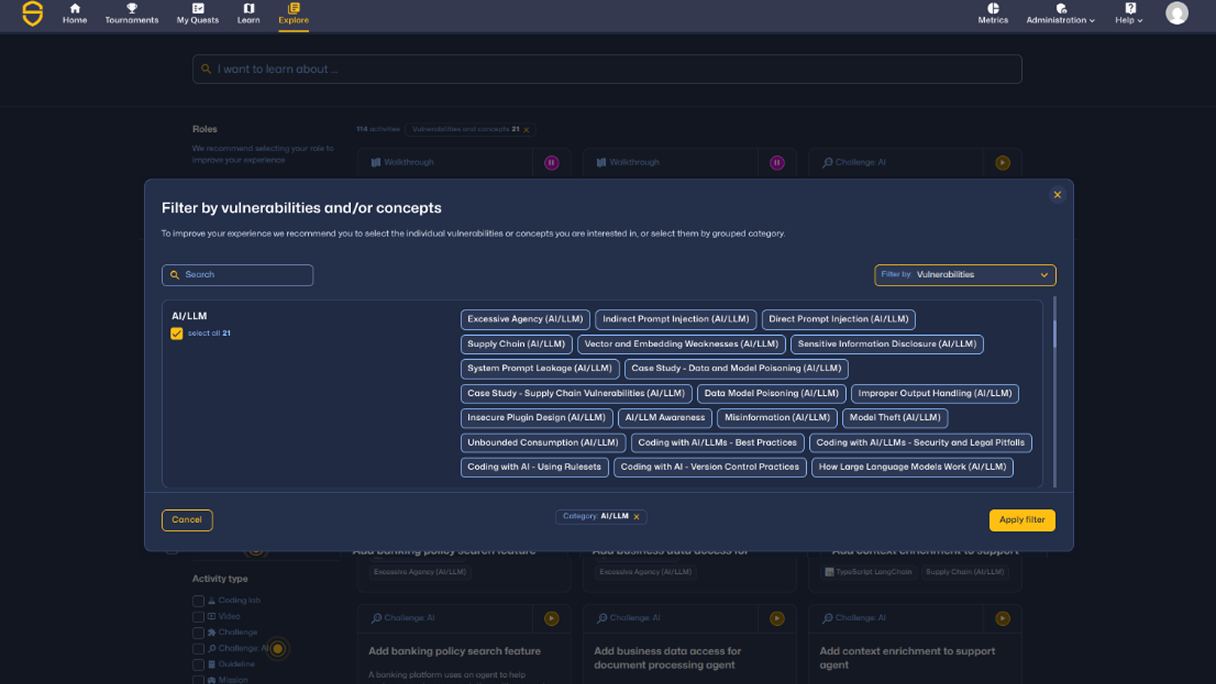

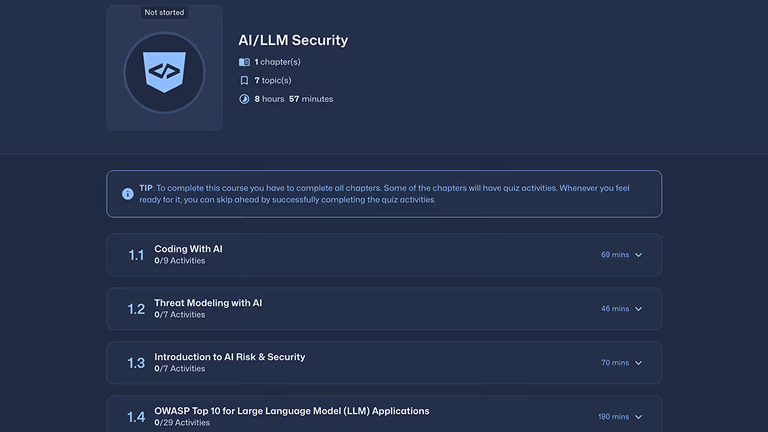

What developers learn in AI security training

Coverage spans LLM vulnerabilities, agent protocols, infrastructure security, and foundational AI security design — mapped to real developer workflows.

Practice real-world AI and LLM security risks.

AI security training teaches developers how to identify, prevent, and remediate vulnerabilities in AI-generated code and modern AI systems, including:

Build foundational AI security knowledge

Developers learn how to securely design and review AI systems through:

Secure AI agents, protocols, and cloud AI environments

Understand and mitigate risks across agent-based systems and AI infrastructure, including MCP and cloud AI services:

Secure AI services and model integrations

Model Context Protocol — Secure AI agents and protocol interactions

AI 거버넌스 팀을 위해 특별히 제작

측정 가능한 개발자 역량을 입증하고 인간 및 AI 지원 개발 전반에서 소프트웨어 위험을 줄이십시오.

보안 코드는 보안 개발자에게서 시작됩니다

보안 코딩 기술을 강화하고, 도입된 취약점을 줄이고, 조직 전체에서 측정 가능한 개발자 신뢰를 구축하세요.

실습 보안 코딩 학습으로 취약성 감소

Secure Code Warrior가 개발자 보안 기술을 개선하고 취약점을 줄이며 측정 가능한 위험 감소를 제공하는 방법을 알아보십시오.